Nuno Cerejeira Namora

Especialista em Direito do Trabalho

Consulte a sua obra neste link.

A Inteligência Artificial, outrora domínio da ficção científica, assume-se cada vez mais como um dos pilares estruturantes da contemporaneidade. Muito longe de ser uma tendência passageira na sociedade, em todos os seus domínios, a Inteligência Artificial produziu uma transformação profunda no mercado de trabalho. Segundo um estudo apresentado pela OCDE, intitulado Job Creation and Local Economic Development 2024, pelo menos 20% das tarefas do trabalhadores podem ser realizadas 50% mais rapidamente com o auxílio da Inteligência Artificial generativa[1]. Tudo indica que a Inteligência Artificial veio para ficar.

É importante salientar, todavia, que a exposição dos trabalhadores à Inteligência Artificial vai continuar a crescer, em virtude do rápido desenvolvimento desta, especialmente no que diz respeito aos trabalhos qualificados de índole intelectual. Ora, como a Inteligência Artificial se tornou num vector transversal de transformação, incidindo sobre sectores tão diversos como a saúde, a educação e o entretenimento, o mundo do trabalho está a ser profundamente reconfigurado pela mesma, não apenas através da substituição de tarefas tipicamente realizadas por humanos, mas também a moldar os critérios de produtividade e eficiência que recaem sobre os trabalhadores.

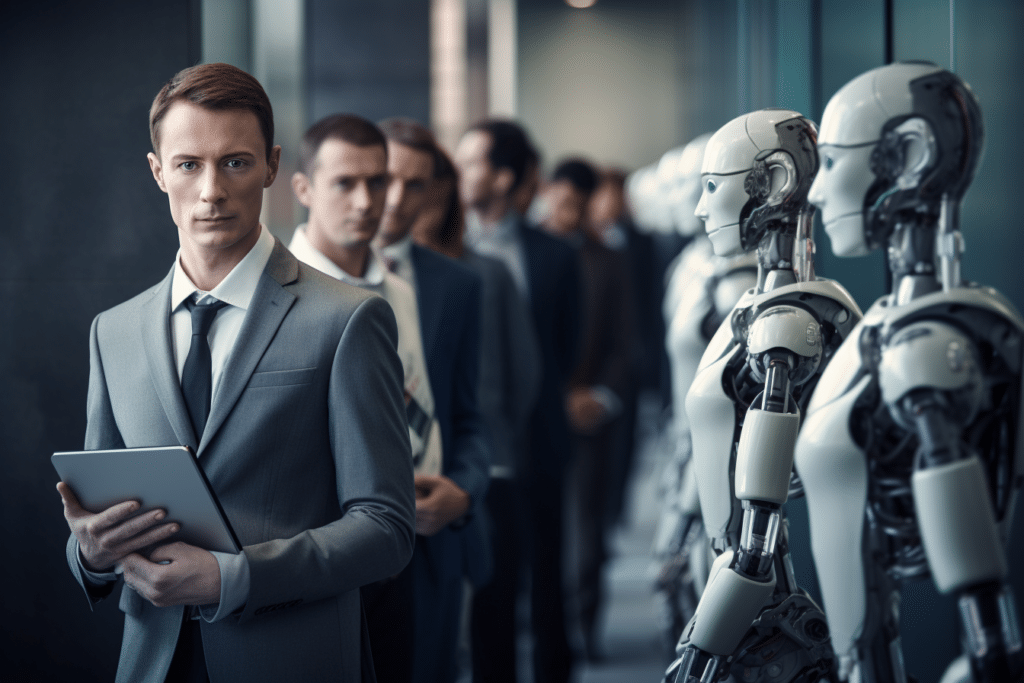

Um exemplo do uso da Inteligência Artificial, em particular, é a sua utilização no âmbito dos recursos humanos. Mais concretamente, no que diz respeito ao recrutamento de pessoas, a verdade é que este processo tem sido cada vez mais mediado por sistemas de Inteligência Artificial: as empresas utilizam algoritmos para fazer a análise e triagem dos currículos e, consequentemente, dos potenciais candidatos a um dado emprego.

A promessa que está subjacente à utilização da Inteligência Artificial é o facto de possibilitar um processo mais rápido (especialmente na análise de dados em larga escala), eficiente, com menor margem de exposição ao potencial erro humano e, alegadamente, «objectivo».

A Inteligência Artificial, em bom rigor, ainda que processe autonomamente dados, aprende com inputs humanos, consubstanciando-se estes em dados e estatísticas históricos e contextuais que, evidentemente, reproduzem formas de discriminação estruturais. Se, por exemplo, o padrão social-tipo de um indivíduo bem-sucedido e dotado de capacidades para trabalhar num determinado emprego com o qual o sistema de Inteligência Artificial aprende for um homem (com formação numa universidade específica), o mesmo vai limitar-se a replicar o padrão com o qual aprendeu.

Do mesmo modo, se no passado certos grupos sociais foram sistematicamente subavaliados em avaliações de desempenho ou discriminados quanto a promoções, a Inteligência Artificial não apenas reproduzirá, em larga escala, esse tratamento diferenciado injustificado, como o «legitimará» sob a égide de uma «objectividade científica». Ademais, a mensuração algorítmica do desempenho de um trabalhador baseia-se, em regra, em dados do mesmo obtidos através de meios invasivos (como, por exemplo, o tempo que o trabalhador passa numa dada aplicação), o que faz da Inteligência Artificial uma ferramenta dotada de uma considerável perigosidade.

Esta hiperquantificação do trabalho reduz o trabalhador a um conjunto de dados, desconsiderando circunstâncias concretas, como a saúde mental, condições socioeconómicas ou até a sobrecarga de trabalho, e factores não quantificáveis, como a criatividade, a resiliência, etc. Ora, se a avaliação do desempenho dos trabalhadores é realizada com base num mecanismo opaco, os trabalhadores são colocados numa posição extremamente vulnerável. Como podem estes contestar uma decisão que, em última instância, é fundada numa black box? Estamos perante uma ferramenta tão complexa e insondável que poderá permitir, ultimamente, a reprodução de um tratamento diferenciado injustificado ao nível das promoções, avaliações de desempenho, distribuição de tarefas, etc.

Neste sentido, o viés algorítmico não se consubstancia numa questão meramente técnica, assumindo-se como um fenómeno ético, político e social. A Inteligência Artificial tende a ocultar, deste modo, aquilo que é, na verdade, um problema sistémico, potenciando os casos de assédio discriminatório.

O grande problema que se coloca, neste âmbito, tem que ver com complexidade associada aos sistemas de Inteligência Artificial. Estes assumem-se, na verdade, como verdadeiras black boxes, atendendo à sua opacidade.

Ora, é precisamente neste ponto que a ideia de uma «due diligence algorítmica» começa a surgir e se revela tão interessante. A responsabilidade jurídica não pode ser diluída no labirinto técnico de todos aqueles envolvidos na concepção, desenvolvimento e implementação de um sistema de Inteligência Artificial. Cumpre, neste âmbito, estipular um conjunto de obrigações atinentes a cada uma destas fases, utilizando-se sempre em contextos laborais sistemas de Inteligência Artificial explicáveis (e, nessa medida, auditáveis e sindicáveis). Apenas desta forma podem as vítimas de assédio discriminatório aceder a elementos probatórios e ver tuteladas as suas posições jurídicas-subjectivas.

A Inteligência Artificial, quando mal regulada, pode tornar-se um instrumento de assédio, de vigilância e de exclusão dos trabalhadores. Para combater este risco revela-se necessária uma verdadeira cultura de compliance e o compromisso político de submeter a tecnologia aos princípios da justiça, da transparência e da responsabilidade.

A importância de reconhecer e combater o assédio laboral em todas as suas formas, incluindo quando o mesmo é mediado por sistemas de Inteligência Artificial, tem vindo a ganhar destaque em fóruns especializados e eventos de caráter interdisciplinar. Um bom exemplo disto é o evento Labour 2030[2], dedicado à reflexão sobre o futuro do trabalho e à construção de ambientes laborais mais justos, seguros e salubres. Iniciativas como esta revelam-se fundamentais para, por exemplo, evidenciar práticas discriminatórias que escondem por detrás da opacidade algorítmica, reforçando a urgência subjacente à implementação de uma cultura de responsabilização ética e jurídica no desenvolvimento e implementação da IA. A revolução algorítmica no contexto laboral pode ser inevitável, mas também é uma escolha.

[1] A Inteligência Artificial generativa (generative Artificial Inteligence) consiste num ramo particular da Inteligência Artificial que se dedica à criação de conteúdo novo com base em padrões aprendidos a partir do processamento de grandes quantidades de dados. A sua diferença para outros sistemas de Inteligência Artificial tradicionais é que esta se revela capaz de gerar textos, imagens, vídeos, entre outros tipos de conteúdo. OCDE. (2024). Job Creation and Local Economic Development 2024: The Geography of Generative AI. OCDE, p. 12. Disponível em: